AI로 글을 작성해도 SEO에 불리하지 않습니다 : 직접 검증한 결과를 공유합니다.

AI로 쓴 글은 SEO에 불리할까? 이 블로그가 직접 검증했습니다. Jekyll에서 Next.js로 마이그레이션하고, AI 콘텐츠 + 기술적 SEO로 검색 노출 0에서 일일 3,000건을 돌파한 과정을 공개합니다.

"AI로 쓴 글은 구글이 패널티를 준다", "AI 콘텐츠는 검색 순위에서 밀린다"

이런 말을 한 번쯤 들어보셨을 겁니다. 결론부터 말하면, 사실이 아닙니다. 이 블로그로 그 과정을 직접 증명하는 실험을 진행하고 있습니다.

이 글에서는 AI로 작성한 콘텐츠가 SEO에 불리하지 않다는 것을 실제 데이터와 함께 보여드리고, 그 과정에서 어떤 SEO 작업을 했는지 구체적으로 공유하겠습니다.

AI 블로그는 어떻게 시작되었나?

지금 보고 계시는 제 블로그(digitalmarketer.co.kr)는 2021년 무렵부터 운영해온 개인 블로그입니다. 원래는 Jekyll(정적 사이트 생성 언어)로 만들어서 GitHub Pages에 배포하고 있었습니다.

Jekyll 시절의 문제점은 명확했습니다.

- 글을 쓸 때마다 마크다운 파일을 직접 작성하고, 파일명 규칙을 지켜야 했습니다

- SEO 메타데이터(title, description, og 태그 등)를 매번 수동으로 입력해야 했습니다

- 사이트 디자인을 수정하려면 Ruby 환경 세팅부터 해야 했습니다

- 유지보수가 번거로워서 점점 글을 안 쓰게 되었습니다

결과적으로 블로그는 거의 방치 상태가 되었고, 2026년 1월까지 검색 트래픽은 사실상 0에 가까웠습니다. 즉, 흔히 말하는 죽은 웹사이트였던거죠.

AI 바이브코딩으로 블로그를 다시 만들면 어떻게 될까?

2025년 12월, AI 코딩 도구(Claude Code)를 활용해서 블로그를 Next.js 기반의 풀스택 웹앱으로 완전히 새로 만들었습니다. 소위 말하는 '바이브코딩'으로 만든 겁니다.

바뀐 점은 이렇습니다.

| 항목 | Jekyll 시절 | Next.js 전환 후 |

|---|---|---|

| 글 작성 | 마크다운 파일 수동 작성 | 관리자 페이지에서 에디터로 작성 |

| SEO 메타데이터 | 수동 입력 | AI가 자동 생성 + 수동 보정 |

| 사이트맵 | 플러그인 의존 | 주제별 인덱스 구조로 자동 생성 |

| 구조화된 데이터 | 없음 | JSON-LD Article/FAQPage 스키마 자동 삽입 |

| 배포 | GitHub Pages + 수동 빌드 | Vercel 자동 배포 |

| 콘텐츠 생성 | 100% 수동 | AI 활용 + 팩트체크/편집 |

그리고 전환 후 올린 글의 상당수는 AI를 활용해서 작성하고 있습니다. 주제 헤더 구조. 기획, 구조화, 본문 작성에 AI를 쓰고, 초안 작성, 팩트체크와 세부적인 편집만 직접 수행하는 방식입니다.

AI 콘텐츠로 트래픽이 실제로 올랐을까?

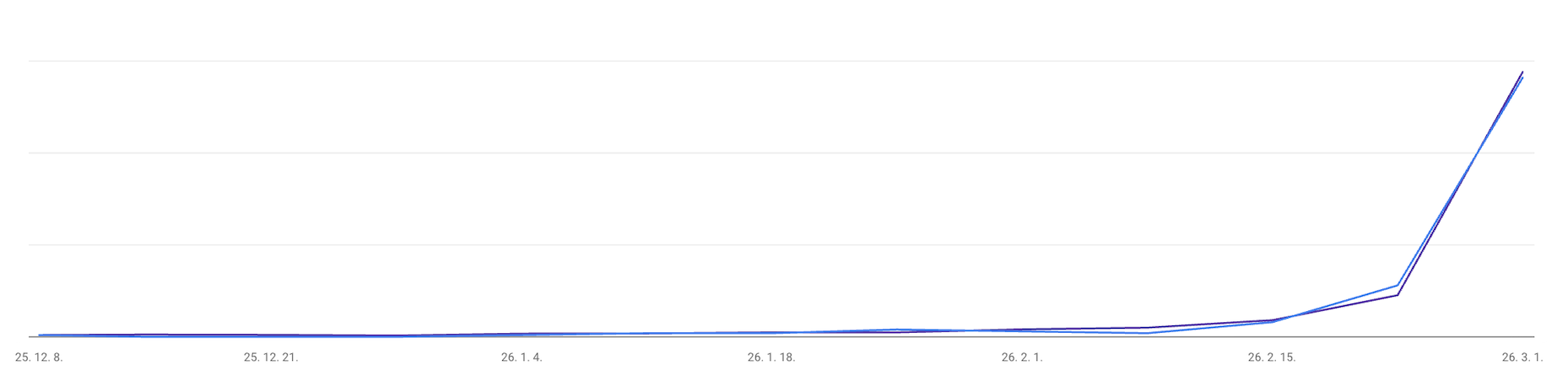

아래는 Google Search Console에서 확인한 실제 검색 노출 데이터입니다.

2026년 1월까지 바닥이었던 검색 노출이, 2월 중순부터 급격히 올라가기 시작했습니다.

이 기간에 올린 글의 대부분은 AI를 활용해서 작성한 콘텐츠입니다. 만약 "AI로 쓴 글은 SEO에 불리하다"는 말이 사실이라면, 이 그래프는 나올 수 없을 것 입니다.

AI 콘텐츠에 대한 Google의 공식 입장은?

Google은 AI 생성 콘텐츠에 대해 명확한 입장을 밝히고 있습니다.

"적절하게 사용하는 한, AI 도구를 사용하여 콘텐츠를 생성하는 것은 Google 검색 가이드라인에 위배되지 않습니다."

Google이 처벌하는 것은 "AI로 쓴 글"이 아니라 "사용자에게 도움이 되지 않는 저품질 글"입니다. 이것은 AI 여부와 무관합니다. 사람이 쓴 글이라도 내용이 부실하면 검색 순위에서 밀리고, AI가 쓴 글이라도 유용하면 상위에 노출됩니다.

Google의 콘텐츠 품질 기준은 E-E-A-T(Experience, Expertise, Authoritativeness, Trustworthiness)입니다.

| 기준 | 의미 | AI 콘텐츠에서 충족하는 법 |

|---|---|---|

| Experience (경험) | 직접 경험에 기반한 콘텐츠인가 | 실제 사례, 직접 검증한 데이터 포함 |

| Expertise (전문성) | 해당 분야에 대한 전문 지식이 있는가 | 정확한 팩트, 구체적 수치, 실무 관점 반영 |

| Authoritativeness (권위) | 해당 주제에서 신뢰받는 출처인가 | 출처 명시, 지속적인 콘텐츠 축적 |

| Trustworthiness (신뢰) | 정보가 정확하고 믿을 수 있는가 | 팩트체크, 최신 정보 반영, 오류 수정 |

AI를 도구로 활용하되, 위 기준을 충족하는 콘텐츠를 만들면 됩니다. 이 블로그는 정확히 그 방식으로 운영되고 있습니다.

AI 콘텐츠 + SEO : 실제로 한 작업들

트래픽이 올라간 건 단순히 "AI로 글을 많이 썼기 때문"이 아닙니다. SEO 기본기를 제대로 갖춘 위에 AI 콘텐츠를 올렸기 때문입니다.

이 블로그에 실제로 수행했던 SEO 작업을 공개합니다. 모두 이 프로젝트의 Git 커밋 히스토리에 기록되어 있는 실제 작업이며, SEO가 필요한 분들은 그대로 따라하시면 도움이 될 것입니다.

1. Google Search Console 연결 및 소유권 인증

가장 먼저 한 일은 Google Search Console에 사이트를 등록하고 소유권을 인증한 것입니다. 이것 없이는 Google이 이 사이트를 제대로 인식하지 못합니다.

사이트의 <head> 태그에 Google 인증 메타 태그를 추가했습니다.

2. robots.txt 설정

검색엔진 봇(크롤러)에게 "이 사이트에서 어떤 페이지를 봐도 되고, 어떤 페이지는 보지 마세요"라고 알려주는 파일입니다.

- 공개 페이지 : 크롤링 허용

- 관리자 페이지(/admin/), API 라우트(/api/) : 크롤링 차단

- 사이트맵 위치 명시

3. 사이트맵 주제별 인덱스 구조로 개편

사이트맵은 "이 사이트에 어떤 페이지들이 있는지" 검색엔진에게 알려주는 목록입니다.

처음에는 모든 페이지를 하나의 사이트맵에 넣었지만, 콘텐츠가 늘어나면서 주제별로 사이트맵을 분리했습니다.

/sitemap: /sitemap/0~2를 연결/sitemap/0: Insights(블로그 글)/sitemap/1: Class(학습 콘텐츠)/sitemap/2: FAQ, Logs 등 기타 페이지

추가로 Google 검색엔진이 무시하는 것으로 알려진 priority와 changefreq 태그는 제거하고, lastmod(마지막 수정일)만 DB의 실제 콘텐츠 업데이트 시간 기반으로 정확하게 넣었습니다.

4. 구조화된 데이터(JSON-LD) 스키마 적용

구조화된 데이터는 검색엔진에게 "이 페이지가 어떤 종류의 콘텐츠인지" 기계가 읽을 수 있는 형식으로 알려주는 것입니다.

| 페이지 유형 | 적용한 스키마 |

|---|---|

| 블로그 글(Insights) | Article |

| FAQ | FAQPage |

| 학습 콘텐츠(Class) | Article |

처음에는 BlogPosting 타입을 사용했다가, 콘텐츠 성격에 더 맞는 Article 타입으로 변경하기도 했습니다. 이런 세부 조정도 SEO에 영향을 줍니다.

5. SEO 메타데이터 자동 생성 시스템

모든 글에 대해 아래 메타데이터를 체계적으로 관리합니다.

title태그 : 검색 결과에 표시되는 제목meta description: 검색 결과 제목 아래 표시되는 설명og:title,og:description,og:image: SNS 공유 시 표시되는 정보canonical URL: 중복 페이지 방지를 위한 대표 URL 지정

이 메타데이터를 매번 수동으로 작성하면 빠뜨리기 쉽습니다. 이 블로그에서는 AI가 글 내용을 기반으로 메타데이터 초안을 자동 생성하고, 필요시 제가 수동으로 보정하는 방식을 사용합니다.

*참고로 keyword는 SEO에 큰 도움이 되지 않아 생략합니다.

6. 구 URL 301 리다이렉트

Jekyll 시절의 URL 구조와 Next.js 전환 후의 URL 구조가 달라졌기 때문에, 기존 URL로 들어오는 방문자가 404 오류를 만나지 않도록 301 리다이렉트(영구 이동)를 설정했습니다.

이는 기존에 쌓여있던 검색 순위 점수(link equity)가 새 URL로 이전되도록 하는 효과도 있습니다. 만약, 웹사이트 리뉴얼을 앞두고 있는 분들이라면 301 리다이렉트(영구 이동)를 설정하는 것이 중요하다는 점을 꼭 기억해주세요.

7. SSG/ISR 하이브리드 렌더링 전환

기존에는 모든 페이지를 서버에서 실시간으로 생성(Server-Side Rendering)했지만, SSG(Static Site Generation) + ISR(Incremental Static Regeneration) 방식으로 전환했습니다.

이렇게 하면 페이지가 미리 HTML로 생성되어 있어서 로딩 속도가 빨라지고, Google 크롤러가 페이지를 더 효율적으로 수집할 수 있습니다. 페이지 로딩 속도는 Google이 공식적으로 밝힌 검색 순위 요소 중 하나입니다.

"AI로 쓰면 SEO에 불리하다"는 오해는 왜 퍼졌을까?

이 오해가 퍼진 데는 나름의 이유가 있습니다.

이유 1 : AI 초창기의 저품질 콘텐츠 범람

ChatGPT가 처음 나왔을 때, 많은 사람들이 AI에게 "~에 대해 블로그 글 써줘"라고만 하고, 검토 없이 그대로 발행했습니다. 이런 글들은 내용이 피상적이고, 팩트 오류가 있고, 어디서나 볼 수 있는 뻔한 내용이었습니다.

이런 글이 검색 순위에서 밀린 건 "AI로 썼기 때문"이 아니라 "품질이 낮았기 때문"입니다. 사람이 10분 만에 대충 쓴 글도 마찬가지로 밀립니다.

이유 2 : Google의 "Helpful Content Update" 오해

2022년과 2023년에 Google이 시행한 Helpful Content Update 이후, "AI 콘텐츠를 타겟으로 한 업데이트"라는 해석이 퍼졌습니다. 하지만 Google은 이 업데이트의 목적이 "사용자에게 도움이 되지 않는 콘텐츠를 걸러내는 것"이라고 명시했습니다. AI 여부가 기준이 아닙니다.

이유 3 : AI 탐지 도구의 오작동

"AI가 쓴 글인지 탐지하는 도구"가 여럿 나왔지만, 이런 도구들은 정확도가 매우 낮습니다. 사람이 쓴 글을 AI가 쓴 것으로 판단하거나, 그 반대의 경우도 빈번합니다. Google도 AI 탐지를 검색 순위 결정에 사용하지 않습니다.

AI 콘텐츠로 SEO 성과를 내려면 어떻게 해야 할까?

AI를 활용하되 검색 성과를 내려면, 아래 원칙을 지키면 됩니다.

원칙 1 : AI 초안을 그대로 발행하지 마세요

AI가 만든 초안은 말 그대로 초안입니다. 아래 과정을 거쳐야 합니다.

- 팩트체크 : AI는 틀린 정보를 자신 있게 말하는 경우가 있습니다. 특히 숫자, 날짜, 고유명사는 반드시 확인하세요

- 구체성 추가 : "~하면 좋습니다" 같은 뻔한 조언 대신, 실제 사례나 구체적 수치를 넣으세요

- 관점 추가 : AI의 중립적인 서술에 자신의 경험이나 의견을 더하세요

이 블로그도 동일한 과정을 거칩니다. 예를 들어 GA4 할당량에 대한 글을 쓸 때, AI의 초안에 있던 "Core Reporting API"라는 UA 시절 용어를 팩트체크를 통해 "Google Analytics Data API v1"로 수정하고, 실제 토큰 한도(시간당 40,000 / 일일 200,000)를 Google 공식 문서에서 확인해서 반영했습니다.

원칙 2 : 검색 의도에 맞는 주제를 선정하세요

아무리 잘 쓴 글이라도, 아무도 검색하지 않는 주제면 트래픽이 오지 않습니다.

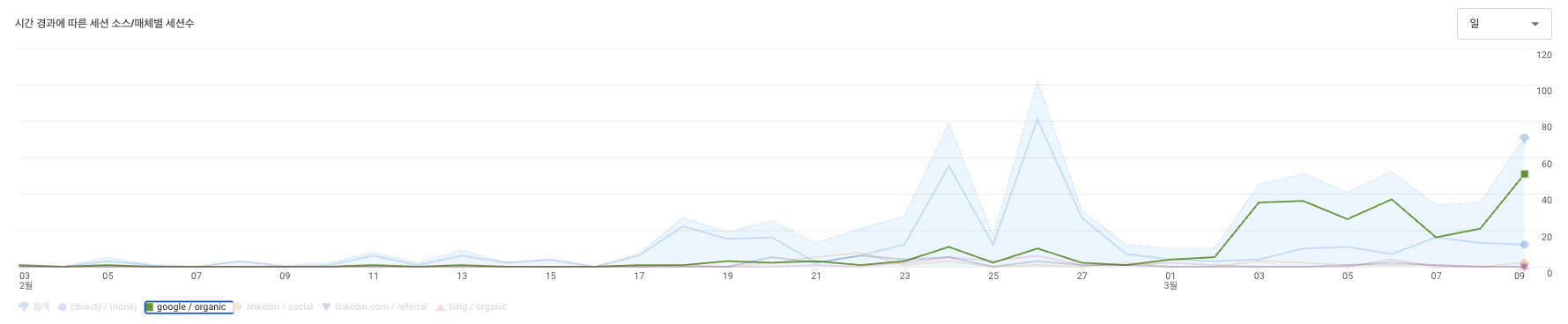

그렇다면 AI로 작성한 글이 실제 검색 트래픽에 어떤 영향을 미칠까요? 이 블로그에서는 Google Search Console의 검색어 데이터를 분석해서, 사람들이 실제로 검색하는 키워드와 현업에서 궁금해하는 주제를 파악한 뒤 글을 작성합니다. AI가 글을 빠르게 생산해주기 때문에, 이 과정에서 시간을 아껴 주제 선정과 품질 검수에 더 집중할 수 있습니다.

원칙 3 : Technical SEO 기본 설정을 갖추세요

아무리 좋은 글이라도, 검색엔진이 페이지를 제대로 인식하지 못하면 노출되지 않습니다. 앞서 공개한 7가지 작업(Search Console 등록, robots.txt, 사이트맵, 구조화 데이터, 메타데이터, 리다이렉트, SSG 전환)은 글의 내용과 무관한 기술적 토대(테크티컬 SEO)입니다. 이 토대가 없으면 좋은 콘텐츠도 묻힙니다.

원칙 4 : 꾸준히 발행하세요

Google은 꾸준히 새 콘텐츠가 올라오는 사이트를 더 자주 크롤링합니다. AI를 활용하면 콘텐츠 생산 속도가 빨라지기 때문에, 꾸준한 발행이 훨씬 수월해집니다. 이것은 AI 콘텐츠의 가장 실질적인 장점입니다.

앞으로의 계획 : SEO 실험을 계속 공개해보려 합니다.

이 블로그는 단순한 콘텐츠 블로그가 아니라, SEO에 대한 낭설과 진실을 직접 검증하는 실험 블로그이기도 합니다.

앞으로 아래 내용을 주기적으로 공유할 예정입니다.

- Search Console 데이터 공개 : 실제 검색어, 노출 수, 클릭 수, 평균 순위 변화

- 콘텐츠 전략 공유 : 어떤 키워드를 타겟으로 글을 썼고, 결과가 어땠는지

- 기술적 SEO 변경 기록 : 사이트 구조, 렌더링 방식, 스키마 변경이 검색 성과에 미친 영향

- AI 활용 방식 공유 : AI로 글을 쓸 때의 프로세스와 품질 관리 방법

"AI 콘텐츠는 SEO에 불리하다"는 통념이 맞는지, 아니면 제대로 활용하면 오히려 유리한지, 이 블로그의 데이터가 그 답을 보여줄 것입니다. AI 시대의 검색 환경 변화가 궁금하다면 AI Overviews 이후 오가닉 CTR 변화와 제로클릭 마케팅 전략도 함께 확인해 보세요. 다행히 현재까지는 SEO 유리한 방향으로 흘러가고 있습니다.

마무리

Google은 AI로 쓴 글을 처벌하지 않습니다. 처벌하는 것은 사용자에게 도움이 되지 않는 저품질 콘텐츠이고, 이것은 사람이 쓰든 AI가 쓰든 동일합니다.

AI는 콘텐츠 생산의 속도를 높여주는 도구입니다. 그 속도를 더 많은 저품질 글을 찍어내는 데 쓰면 역효과가 나고, 주제 선정과 품질 검수에 시간을 투자하는 데 쓰면 SEO 성과로 이어집니다.

3줄 요약:

- Google은 AI 생성 콘텐츠를 처벌하지 않습니다. 처벌 대상은 "AI로 쓴 글"이 아니라 "사용자에게 도움이 되지 않는 저품질 글"입니다.

- 이 블로그는 AI로 콘텐츠를 작성하면서 기술적 SEO(사이트맵, 구조화 데이터, 메타데이터, SSG 전환 등)를 갖춘 결과, 검색 노출이 0에서 일일 3,000건 이상으로 성장했습니다.

- AI의 속도를 품질 검수와 주제 선정에 투자하면 SEO에 오히려 유리합니다.

AI로 작성한 콘텐츠의 SEO에 대한 Google의 공식 입장으로 올바른 것은?